Вычислить значение статистики критерия пирсона. Критерий Пирсона. Проверка гипотезы о нормальном распределении

Критерий корреляции Пирсона – это метод параметрической статистики, позволяющий определить наличие или отсутствие линейной связи между двумя количественными показателями, а также оценить ее тесноту и статистическую значимость. Другими словами, критерий корреляции Пирсона позволяет определить, есть ли линейная связь между изменениями значений двух переменных. В статистических расчетах и выводах коэффициент корреляции обычно обозначается как r xy или R xy .

1. История разработки критерия корреляции

Критерий корреляции Пирсона был разработан командой британских ученых во главе с Карлом Пирсоном (1857-1936) в 90-х годах 19-го века, для упрощения анализа ковариации двух случайных величин. Помимо Карла Пирсона над критерием корреляции Пирсона работали также Фрэнсис Эджуорт и Рафаэль Уэлдон .

2. Для чего используется критерий корреляции Пирсона?

Критерий корреляции Пирсона позволяет определить, какова теснота (или сила) корреляционной связи между двумя показателями, измеренными в количественной шкале. При помощи дополнительных расчетов можно также определить, насколько статистически значима выявленная связь.

Например, при помощи критерия корреляции Пирсона можно ответить на вопрос о наличии связи между температурой тела и содержанием лейкоцитов в крови при острых респираторных инфекциях, между ростом и весом пациента, между содержанием в питьевой воде фтора и заболеваемостью населения кариесом.

3. Условия и ограничения применения критерия хи-квадрат Пирсона

- Сопоставляемые показатели должны быть измерены в количественной шкале (например, частота сердечных сокращений, температура тела, содержание лейкоцитов в 1 мл крови, систолическое артериальное давление).

- Посредством критерия корреляции Пирсона можно определить лишь наличие и силу линейной взаимосвязи между величинами. Прочие характеристики связи, в том числе направление (прямая или обратная), характер изменений (прямолинейный или криволинейный), а также наличие зависимости одной переменной от другой - определяются при помощи регрессионного анализа .

- Количество сопоставляемых величин должно быть равно двум. В случае анализ взаимосвязи трех и более параметров следует воспользоваться методом факторного анализа .

- Критерий корреляции Пирсона является параметрическим , в связи с чем условием его применения служит нормальное распределение сопоставляемых переменных. В случае необходимости корреляционного анализа показателей, распределение которых отличается от нормального, в том числе измеренных в порядковой шкале, следует использовать коэффициент ранговой корреляции Спирмена .

- Следует четко различать понятия зависимости и корреляции. Зависимость величин обуславливает наличие корреляционной связи между ними, но не наоборот.

Например, рост ребенка зависит от его возраста, то есть чем старше ребенок, тем он выше. Если мы возьмем двух детей разного возраста, то с высокой долей вероятности рост старшего ребенка будет больше, чем у младшего. Данное явление и называется зависимостью , подразумевающей причинно-следственную связь между показателями. Разумеется, между ними имеется и корреляционная связь , означающая, что изменения одного показателя сопровождаются изменениями другого показателя.

В другой ситуации рассмотрим связь роста ребенка и частоты сердечных сокращений (ЧСС). Как известно, обе эти величины напрямую зависят от возраста, поэтому в большинстве случаев дети большего роста (а значит и более старшего возраста) будут иметь меньшие значения ЧСС. То есть, корреляционная связь будет наблюдаться и может иметь достаточно высокую тесноту. Однако, если мы возьмем детей одного возраста , но разного роста , то, скорее всего, ЧСС у них будет различаться несущественно, в связи с чем можно сделать вывод о независимости ЧСС от роста.

Приведенный пример показывает, как важно различать фундаментальные в статистике понятия связи и зависимости показателей для построения верных выводов.

4. Как рассчитать коэффициента корреляции Пирсона?

Расчет коэффициента корреляции Пирсона производится по следующей формуле:

5. Как интерпретировать значение коэффициента корреляции Пирсона?

Значения коэффициента корреляции Пирсона интерпретируются исходя из его абсолютных значений. Возможные значения коэффициента корреляции варьируют от 0 до ±1. Чем больше абсолютное значение r xy – тем выше теснота связи между двумя величинами. r xy = 0 говорит о полном отсутствии связи. r xy = 1 – свидетельствует о наличии абсолютной (функциональной) связи. Если значение критерия корреляции Пирсона оказалось больше 1 или меньше -1 – в расчетах допущена ошибка.

Для оценки тесноты, или силы, корреляционной связи обычно используют общепринятые критерии, согласно которым абсолютные значения r xy < 0.3 свидетельствуют о слабой связи, значения r xy от 0.3 до 0.7 - о связи средней тесноты, значения r xy > 0.7 - о сильной связи.

Более точную оценку силы корреляционной связи можно получить, если воспользоваться таблицей Чеддока :

Оценка статистической значимости коэффициента корреляции r xy осуществляется при помощи t-критерия, рассчитываемого по следующей формуле:

![]()

Полученное значение t r сравнивается с критическим значением при определенном уровне значимости и числе степеней свободы n-2. Если t r превышает t крит, то делается вывод о статистической значимости выявленной корреляционной связи.

6. Пример расчета коэффициента корреляции Пирсона

Целью исследования явилось выявление, определение тесноты и статистической значимости корреляционной связи между двумя количественными показателями: уровнем тестостерона в крови (X) и процентом мышечной массы в теле (Y). Исходные данные для выборки, состоящей из 5 исследуемых (n = 5), сведены в таблице.

В некоторых случаях исследователь не знает заранее, по какому именно закону распределены наблюдаемые значение исследуемого признака. Но у него могут быть достаточно веские причины предполагать, что распределение подчинено тому или иному закону, например, нормальному или равномерному. В этом случае выдвигаются основная и альтернативная статистические гипотезы следующего вида:

H 0: распределение наблюдаемого признака подчинено закону распределения A ,

H 1: распределение наблюдаемого признака отличается от A ;

где в качестве A может выступать тот или иной закон распределения: нормальный, равномерный, показательный и т. д.

Проверка гипотезы о предполагаемом законе распределения проводится при помощи так называемых критериев согласия. Имеется несколько критериев согласия. Наиболее универсальным из них является -критерий Пирсона, так как он применим к любому виду распределения.

-Критерий Пирсона

Обычно эмпирические и теоретические частоты различаются. Случайно ли расхождение частот? Критерий Пирсона дает ответ на этот вопрос, правда, как и любой статистический критерий, он не доказывает справедливость гипотезы в строго математическом смысле, а лишь устанавливает на определенном уровне значимости ее согласие или несогласие с данными наблюдений.

Итак, пусть по выборке объема получено статистическое распределение значений признака, где- наблюдаемые значения признака,- соответствующие им частоты:

Суть критерия Пирсона состоит в вычислении критерия по следующей формуле:

![]()

где - это число разрядов наблюдаемых значений, а- теоретические частоты соответствующих значений.

Понятно, что чем меньше разности , тем ближе эмпирическое распределение к эмпирическому, поэтому, чем меньше значение критерия, тем с большей достоверностью можно утверждать, что эмпирическое и теоретическое распределение подчинены одному закону.

Алгоритм критерия Пирсона

Алгоритм критерия Пирсона несложен и состоит в выполнении следующих действий:

Итак, единственным нетривиальным действием в этом алгоритме является определение теоретических частот. Они, разумеется, зависят от закона распределения, поэтому - для различных законов определяются по-разному.

Критерий Пирсона

Критерий Пирсона , или критерий χ 2 - наиболее часто употребляемый критерий для проверки гипотезы о законе распределения . Во многих практических задачах точный закон распределения неизвестен, то есть является гипотезой, которая требует статистической проверки.

Обозначим через X исследуемую случайную величину . Пусть требуется проверить гипотезу H 0 о том, что эта случайная величина подчиняется закону распределения F (x ) . Для проверки гипотезы произведём выборку, состоящую из n независимых наблюдений над случайной величиной X. По выборке можно построить эмпирическое распределение F * (x ) исследуемой случайной величины. Сравнение эмпирического F * (x ) и теоретического распределений производится с помощью специально подобранной случайной величины - критерия согласия . Одним из таких критериев и является критерий Пирсона.

Статистика критерия

Для проверки критерия вводится статистика:

где  - предполагаемая вероятность попадения в i

-й интервал, - соответствующее эмпирическое значение, n

i

- число элементов выборки из i

-го интервала.

- предполагаемая вероятность попадения в i

-й интервал, - соответствующее эмпирическое значение, n

i

- число элементов выборки из i

-го интервала.

Эта величина в свою очередь является случайной (в силу случайности X) и должна подчиняться распределению χ 2 .

Правило критерия

Перед тем, как сформулировать правило принятия или отвержения гипотезы необходимо учесть, что критерий Пирсона обладает правосторонней критической областью .

| Правило.

Если полученная статистика превосходит квантиль закона распределения заданного уровня значимости с или с степенями свободы , где k - число наблюдений или число интервалов (для случая интервального вариационного ряда), а p - число оцениваемых параметров закона распределения , то гипотеза отвергается. В противном случае гипотеза принимается на заданном уровне значимости . |

Литература

- Кендалл М., Стьюарт А. Статистические выводы и связи. - М.: Наука, 1973.

См. также

- Критерий Пирсона на сайте Новосибирского государственного университета

- Критерии типа хи-квадрат на сайте Новосибирского государственного технического университета (Рекомендации по стандартизации Р 50.1.033–2001)

- О выборе числа интервалов на сайте Новосибирского государственного технического университета

- О критерии Никулина на сайте Новосибирского государственного технического университета

Wikimedia Foundation . 2010 .

Смотреть что такое "Критерий Пирсона" в других словарях:

Критерий Пирсона, или критерий χ² (Хи квадрат) наиболее часто употребляемый критерий для проверки гипотезы о законе распределения. Во многих практических задачах точный закон распределения неизвестен, то есть является гипотезой, которая… … Википедия

Или Критерий согласия Колмогорова Смирнова статистический критерий, использующийся для определения того, подчиняются ли два эмпирических распределения одному закону, либо того, подчиняется ли полученное распределение предполагаемой модели.… … Википедия

- (максиминный критерий) один из критериев принятия решений в условиях неопределённости. Критерий крайнего пессимизма. История Критерий Вальда был предложен Абрахамом Вальдом в 1955 году для выборок равного объема, а затем распространен на … Википедия

Уоллиса предназначен для проверки равенства медиан нескольких выборок. Данный критерий является многомерным обобщением критерия Уилкоксона Манна Уитни. Критерий Краскела Уоллиса является ранговым, поэтому он инвариантен по отношению к любому… … Википедия

- (F критерий, φ* критерий, критерий наименьшей значимой разности) апостериорный статистический критерий, используемый для сравнения дисперсий двух вариационных рядов, то есть для определения значимых различий между групповыми средними в… … Википедия

Критерий Кохрена используют при сравнении трёх и более выборок одинакового объёма. Расхождение между дисперсиями считается случайным при выбранном уровне значимости, если: где квантиль случайной величины при числе суммируемых… … Википедия

Статистический критерий, названный по имени Хьюберта Лиллиефорса, профессора статистики Университета Джорджа Вашингтона, являющийся модификацией критерия Колмогорова–Смирнова. Используется для проверки нулевой гипотезы о том, что выборка… … Википедия

Для улучшения этой статьи желательно?: Найти и оформить в виде сносок ссылки на авторитетные источники, подтверждающие написанное. Добавить иллюстрации. Т Крит … Википедия

В статистике критерий согласия Колмогорова (также известный, как критерий согласия Колмогорова Смирнова) используется для того, чтобы определить, подчиняются ли два эмпирических распределения одному закону, либо определить, подчиняется ли… … Википедия

критерий независимости - для таблиц сопряженности проверяет гипотезу о том, что переменные строки и столбца независимы. К таким критериям относится критерий независимости хи квадрат (Пирсона) и точный критерий Фишера … Словарь социологической статистики

Книги

- Критерии проверки отклонения распределения от равномерного закона. Руководство по применению: монография , Лемешко Б.Ю.. Книга рассчитана на специалистов, в той или иной степени сталкивающихся в своей деятельности с вопросами статистического анализа данных с обработкой результатовэкспериментов, применением…

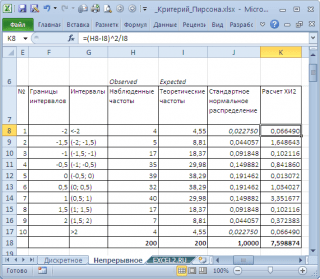

Рассмотрим применение в MS EXCEL критерия хи-квадрат Пирсона для проверки простых гипотез.

После получения экспериментальных данных (т.е. когда имеется некая выборка ) обычно производится выбор закона распределения, наиболее хорошо описывающего случайную величину, представленную данной выборкой . Проверка того, насколько хорошо экспериментальные данные описываются выбранным теоретическим законом распределения, осуществляется с использованием критериев согласия . Нулевой гипотезой , обычно выступает гипотеза о равенстве распределения случайной величины некоторому теоретическому закону.

Сначала рассмотрим применение критерия согласия Пирсона Х 2 (хи-квадрат) в отношении простых гипотез (параметры теоретического распределения считаются известными). Затем - , когда задается только форма распределения, а параметры этого распределения и значение статистики Х 2 оцениваются/рассчитываются на основании одной и той же выборки .

Примечание : В англоязычной литературе процедура применения критерия согласия Пирсона Х 2 имеет название The chi-square goodness of fit test .

Напомним процедуру проверки гипотез:

- на основе выборки вычисляется значение статистики , которая соответствует типу проверяемой гипотезы. Например, для используется t -статистика (если не известно);

- при условии истинности нулевой гипотезы , распределение этой статистики известно и может быть использовано для вычисления вероятностей (например, для t -статистики это );

- вычисленное на основе выборки значение статистики сравнивается с критическим для заданного значением ();

- нулевую гипотезу отвергают, если значение статистики больше критического (или если вероятность получить это значение статистики () меньше уровня значимости , что является эквивалентным подходом).

Проведем проверку гипотез для различных распределений.

Дискретный случай

Предположим, что два человека играют в кости. У каждого игрока свой набор костей. Игроки по очереди кидают сразу по 3 кубика. Каждый раунд выигрывает тот, кто выкинет за раз больше шестерок. Результаты записываются. У одного из игроков после 100 раундов возникло подозрение, что кости его соперника – несимметричные, т.к. тот часто выигрывает (часто выбрасывает шестерки). Он решил проанализировать насколько вероятно такое количество исходов противника.

Примечание : Т.к. кубиков 3, то за раз можно выкинуть 0; 1; 2 или 3 шестерки, т.е. случайная величина может принимать 4 значения.

Из теории вероятности нам известно, что если кубики симметричные, то вероятность выпадения шестерок подчиняется . Поэтому, после 100 раундов частоты выпадения шестерок могут быть вычислены с помощью формулы

=БИНОМ.РАСП(A7;3;1/6;ЛОЖЬ)*100

В формуле предполагается, что в ячейке А7 содержится соответствующее количество выпавших шестерок в одном раунде.

Примечание : Расчеты приведены в файле примера на листе Дискретное .

Для сравнения наблюденных (Observed) и теоретических частот (Expected) удобно пользоваться .

При значительном отклонении наблюденных частот от теоретического распределения, нулевая гипотеза о распределении случайной величины по теоретическому закону, должна быть отклонена. Т.е., если игральные кости соперника несимметричны, то наблюденные частоты будут «существенно отличаться» от биномиального распределения .

В нашем случае на первый взгляд частоты достаточно близки и без вычислений сложно сделать однозначный вывод. Применим критерий согласия Пирсона Х 2 , чтобы вместо субъективного высказывания «существенно отличаться», которое можно сделать на основании сравнения гистограмм , использовать математически корректное утверждение.

Используем тот факт, что в силу закона больших чисел наблюденная частота (Observed) с ростом объема выборки n стремится к вероятности, соответствующей теоретическому закону (в нашем случае, биномиальному закону ). В нашем случае объем выборки n равен 100.

Введем тестовую статистику , которую обозначим Х 2:

где O l – это наблюденная частота событий, что случайная величина приняла определенные допустимые значения, E l – это соответствующая теоретическая частота (Expected). L – это количество значений, которые может принимать случайная величина (в нашем случае равна 4).

Как видно из формулы, эта статистика является мерой близости наблюденных частот к теоретическим, т.е. с помощью нее можно оценить «расстояния» между этими частотами. Если сумма этих «расстояний» «слишком велика», то эти частоты «существенно отличаются». Понятно, что если наш кубик симметричный (т.е. применим биномиальный закон ), то вероятность того, что сумма «расстояний» будет «слишком велика» будет малой. Чтобы вычислить эту вероятность нам необходимо знать распределение статистики Х 2 (статистика Х 2 вычислена на основе случайной выборки , поэтому она является случайной величиной и, следовательно, имеет свое распределение вероятностей ).

Из многомерного аналога интегральной теоремы Муавра-Лапласа известно, что при n->∞ наша случайная величина Х 2 асимптотически с L - 1 степенями свободы.

Итак, если вычисленное значение статистики Х 2 (сумма «расстояний» между частотами) будет больше чем некое предельное значение, то у нас будет основание отвергнуть нулевую гипотезу . Как и при проверке параметрических гипотез , предельное значение задается через уровень значимости . Если вероятность того, что статистика Х 2 примет значение меньше или равное вычисленному (p -значение ), будет меньше уровня значимости , то нулевую гипотезу можно отвергнуть.

В нашем случае, значение статистики равно 22,757. Вероятность, что статистика Х 2 примет значение больше или равное 22,757 очень мала (0,000045) и может быть вычислена по формулам

=ХИ2.РАСП.ПХ(22,757;4-1)

или

=ХИ2.ТЕСТ(Observed; Expected)

Примечание : Функция ХИ2.ТЕСТ() специально создана для проверки связи между двумя категориальными переменными (см. ).

Вероятность 0,000045 существенно меньше обычного уровня значимости 0,05. Так что, у игрока есть все основания подозревать своего противника в нечестности (нулевая гипотеза о его честности отвергается).

При применении критерия Х 2 необходимо следить за тем, чтобы объем выборки n был достаточно большой, иначе будет неправомочна аппроксимация распределения статистики Х 2 . Обычно считается, что для этого достаточно, чтобы наблюденные частоты (Observed) были больше 5. Если это не так, то малые частоты объединяются в одно или присоединяются к другим частотам, причем объединенному значению приписывается суммарная вероятность и, соответственно, уменьшается число степеней свободы Х 2 -распределения .

Для того чтобы улучшить качество применения критерия Х 2 (), необходимо уменьшать интервалы разбиения (увеличивать L и, соответственно, увеличивать количество степеней свободы ), однако этому препятствует ограничение на количество попавших в каждый интервал наблюдений (д.б.>5).

Непрерывный случай

Критерий согласия Пирсона Х 2 можно применить так же в случае .

Рассмотрим некую выборку , состоящую из 200 значений. Нулевая гипотеза утверждает, что выборка сделана из .

Примечание : Cлучайные величины в файле примера на листе Непрерывное сгенерированы с помощью формулы =НОРМ.СТ.ОБР(СЛЧИС()) . Поэтому, новые значения выборки генерируются при каждом пересчете листа.

Соответствует ли имеющийся набор данных можно визуально оценить .

Как видно из диаграммы, значения выборки довольно хорошо укладываются вдоль прямой. Однако, как и в для проверки гипотезы применим Критерий согласия Пирсона Х 2 .

Для этого разобьем диапазон изменения случайной величины на интервалы с шагом 0,5 . Вычислим наблюденные и теоретические частоты. Наблюденные частоты вычислим с помощью функции ЧАСТОТА() , а теоретические – с помощью функции НОРМ.СТ.РАСП() .

Примечание : Как и для дискретного случая , необходимо следить, чтобы выборка была достаточно большая, а в интервал попадало >5 значений.

Вычислим статистику Х 2 и сравним ее с критическим значением для заданного уровня значимости

(0,05). Т.к. мы разбили диапазон изменения случайной величины на 10 интервалов, то число степеней свободы равно 9. Критическое значение можно вычислить по формуле

=ХИ2.ОБР.ПХ(0,05;9)

или

=ХИ2.ОБР(1-0,05;9)

На диаграмме выше видно, что значение статистики равно 8,19, что существенно выше критического значения – нулевая гипотеза не отвергается.

Ниже приведена , на которой выборка приняла маловероятное значение и на основании критерия согласия Пирсона Х 2 нулевая гипотеза была отклонена (не смотря на то, что случайные значения были сгенерированы с помощью формулы =НОРМ.СТ.ОБР(СЛЧИС()) , обеспечивающей выборку из стандартного нормального распределения ).

Нулевая гипотеза отклонена, хотя визуально данные располагаются довольно близко к прямой линии.

В качестве примера также возьмем выборку из U(-3; 3). В этом случае, даже из графика очевидно, что нулевая гипотеза должна быть отклонена.

Критерий согласия Пирсона Х 2 также подтверждает, что нулевая гипотеза должна быть отклонена.

Критерий согласия для проверки гипотезы о законе распределения исследуемой случайной величины.Во многих практических задачах точный закон распределения неизвестен.Поэтому выдвигается гипотеза о соответствии имеющегося эмпирического закона, построенного по наблюдениям, некоторому теоретическому.Данная гипотеза требует статистической проверки, по результатам которой будет либо подтверждена, либо опровергнута.

Пусть X – исследуемая случайная величина. Требуется проверить гипотезу H 0 о том, что данная случайная величина подчиняется закону распределения F(x). Для этого необходимо произвести выборку из n независимых наблюдений и по ней построить эмпирический закон распределения F"(x). Для сравнения эмпирического и гипотетического законов используется правило, называемое критерием согласия.Одним из популярных является критерий согласия хи-квадрат К. Пирсона.

В нем вычисляется статистика хи-квадрат:

,

,

где N – число интервалов, по которому строился эмпирический закон распределения (число столбцов соответствующей гистограммы), i – номер интервала, p t i - вероятность попадания значения случайной величины в i-й интервал для теоретического закона распределения, p e i – вероятность попадания значения случайной величины в i-й интервал для эмпирического закона распределения. Она и должна подчиняться распределению хи-квадрат.

Если вычисленное значение статистики превосходит квантиль распределения хи-квадрат с k-p-1 степенями свободы для заданного уровня значимости, то гипотеза H 0 отвергается.В противном случае она принимается на заданном уровне значимости.Здесь k – число наблюдений, p – число оцениваемых параметров закона распределения.

Пирсона позволяет осуществлять проверку эмпирического и теоретического (либо другого эмпирического) распределений одного признака. Данный критерий применяется, в основном, в двух случаях:

Для сопоставления эмпирического распределения признака с теоретическим распределением (нормальным, показательным, равномерным либо каким-то иным законом);

Для сопоставления двух эмпирических распределений одного и того же признака.

Идея метода – определение степени расхождения соответствующих частот n i и ; чем больше это расхождение, тем больше значение

Объемы выборок должны быть не меньше 50 и необходимо равенство сумм частот ![]()

Нулевая гипотеза H 0 ={два распределения практически не различаются между собой}; альтернативная гипотеза – H 1 ={расхождение между распределениями существенно}.

Приведем схему применения критерия для сопоставления двух эмпирических распределений:

Критерий - статистический критерий для проверки гипотезы , что наблюдаемая случайная величина подчиняется некому теоретическому закону распределения.

В зависимости от значения критерия , гипотеза может приниматься, либо отвергаться:

§ ![]() , гипотеза выполняется.

, гипотеза выполняется.

§ (попадает в левый "хвост" распределения). Следовательно, теоретические и практические значения очень близки. Если, к примеру, происходит проверка генератора случайных чисел, который сгенерировал n чисел из отрезка и гипотеза : выборка распределена равномерно на , тогда генератор нельзя называть случайным (гипотеза случайности не выполняется), т.к. выборка распределена слишком равномерно, но гипотеза выполняется.

§ (попадает в правый "хвост" распределения) гипотеза отвергается.

Определение: пусть дана случайная величина X .

Гипотеза : с. в. X подчиняется закону распределения .

Для проверки гипотезы рассмотрим выборку, состоящую из n независимых наблюдений над с.в. X: . По выборке построим эмпирическое распределение с.в X. Сравнение эмпирического и теоретического распределения (предполагаемого в гипотезе) производится с помощью специально подобранной функции -критерия согласия. Рассмотрим критерий согласия Пирсона (критерий ):

Гипотеза : Х n порождается функцией .

Разделим на k непересекающихся интервалов ![]() ;

;

Пусть - количество наблюдений в j-м интервале:  ;

;

Вероятность попадания наблюдения в j-ый интервал при выполнении гипотезы ;

![]() - ожидаемое число попаданий в j-ый интервал;

- ожидаемое число попаданий в j-ый интервал;

Статистика:

- Распределение хи-квадрат с k-1 степенью свободы.

- Распределение хи-квадрат с k-1 степенью свободы.

Критерий ошибается на выборках с низкочастотными (редкими) событиями.Решить эту проблему можно отбросив низкочастотные события, либо объединив их с другими событиями.Этот способ называется коррекцией Йетса (Yates" correction).

Критерий согласия Пирсона (χ 2) применяют для проверки гипотезы о соответствии эмпирического распределения предполагаемому теоретическому распределению F(x) при большом объеме выборки (n ≥ 100). Критерий применим для любых видов функции F(x), даже при неизвестных значениях их параметров, что обычно имеет место при анализе результатов механических испытаний. В этом заключается его универсальность.

Использование критерия χ 2 предусматривает разбиение размаха варьирования выборки на интервалы и определения числа наблюдений (частоты) n j для каждого из e интервалов. Для удобства оценок параметров распределения интервалы выбирают одинаковой длины.

Число интервалов зависит от объема выборки. Обычно принимают: при n = 100 e = 10 ÷ 15, при n = 200 e = 15 ÷ 20, при n = 400 e = 25 ÷ 30, при n = 1000 e = 35 ÷ 40.

Интервалы, содержащие менее пяти наблюдений, объединяют с соседними. Однако, если число таких интервалов составляет менее 20 % от их общего количества, допускаются интервалы с частотой n j ≥ 2.

Статистикой критерия Пирсона служит величина , (3.91)

, (3.91)

где p j - вероятность попадания изучаемой случайной величины в j-и интервал, вычисляемая в соответствии с гипотетическим законом распределением F(x). При вычислении вероятности p j нужно иметь в виду, что левая граница первого интервала и правая последнего должны совпадать с границами области возможных значений случайной величины.Например, при нормальном распределении первый интервал простирается до -∞, а последний - до +∞.

Нулевую гипотезу о соответствии выборочного распределения теоретическому закону F(x) проверяют путем сравнения вычисленной по формуле (3.91) величины с критическим значением χ 2 α , найденным по табл. VI приложения для уровня значимости α и числа степеней свободы k = e

1 - m - 1. Здесь e

1 - число интервалов после объединения; m - число параметров, оцениваемых по рассматриваемой выборке.Если выполняется неравенство

χ 2 ≤ χ 2 α (3.92)

то нулевую гипотезу не отвергают.При несоблюдении указанного неравенства принимают альтернативную гипотезу о принадлежности выборки неизвестному распределению.

Недостатком критерия согласия Пирсона является потеря части первоначальной информации, связанная с необходимостью группировки результатов наблюдений в интервалы и объединения отдельных интервалов с малым числом наблюдений.В связи с этим рекомендуется дополнять проверку соответствия распределений по критерию χ 2 другими критериями.Особенно это необходимо при сравнительно малом объеме выборки (n ≈ 100).

В таблице приведены критические значения хи-квадрат распределения с заданным числом степеней свободы.Искомое значение находится на пересечении столбца с соответствующим значением вероятности и строки с числом степеней свободы. Например, критическое значение хи-квадрат распределения с 4-мя степенями свободы для вероятности 0.25 составляет 5.38527. Это означает, что площадь под кривой плотности хи-квадрат распределения с 4-мя степенями свободы справа от значения 5.38527 равна 0.25.